In der digitalen Marketingwelt herrscht eine gefährliche Begriffsverwirrung. Ein neues Akronym macht die Runde: GEO, die Kurzform für „Generative Engine Optimization“.

Inhaltsverzeichnis

Es verspricht Unternehmen, ihre Inhalte und Webseiten speziell für KI-Systeme wie ChatGPT oder Google AI Overviews zu optimieren, ähnlich wie man früher die organischen Rankings bei Google erobert hat. Doch für Entscheider im Mittelstand und SEO-Verantwortliche ist Vorsicht geboten.

Technisch und fachlich betrachtet ist der Begriff „GEO“ irreführend, ja sogar falsch. Es gibt keine „Generative Engine“, die Webseiten in einer statischen Liste sortiert. Wir sollten uns nicht von neuen Buzzwords blenden lassen, sondern verstehen, dass wir es im Kern immer noch mit fundierter Suchmaschinenoptimierung (SEO) zu tun haben.

Richtig ist die weiterentwickelte Form der organischen Sichtbarkeit, die nicht mehr allein auf Rankings, sondern zusätzlich auf technischer Abrufbarkeit und Zitierfähigkeit basiert.

Der Begriff „Engine“ in der Informatik

In der Software-Architektur ist der Begriff „Engine“ fest als Motor oder Triebwerk definiert und bezieht sich auf ein Kern-Modul. Die Engine führt komplexe Berechnungen aus und wird von einer übergeordneten Anwendung gesteuert.

Beispiele für „Engines“ sind die Game Engine, welche Physik berechnet, die Rendering Engine, welche Bildpunkte berechnet und die Database Engine, welche Daten verwaltet.

Ein Large Language Model (LLM) ist nur eine statische Datei. Damit das Model antwortet, benötigt es eine Laufzeitumgebung. Diese Software nennt man fachlich korrekt Inference Engine.

Textinhalte lassen sich nicht spezifisch für die Inference Engine optimieren, die nur das Ergebnis berechnet.

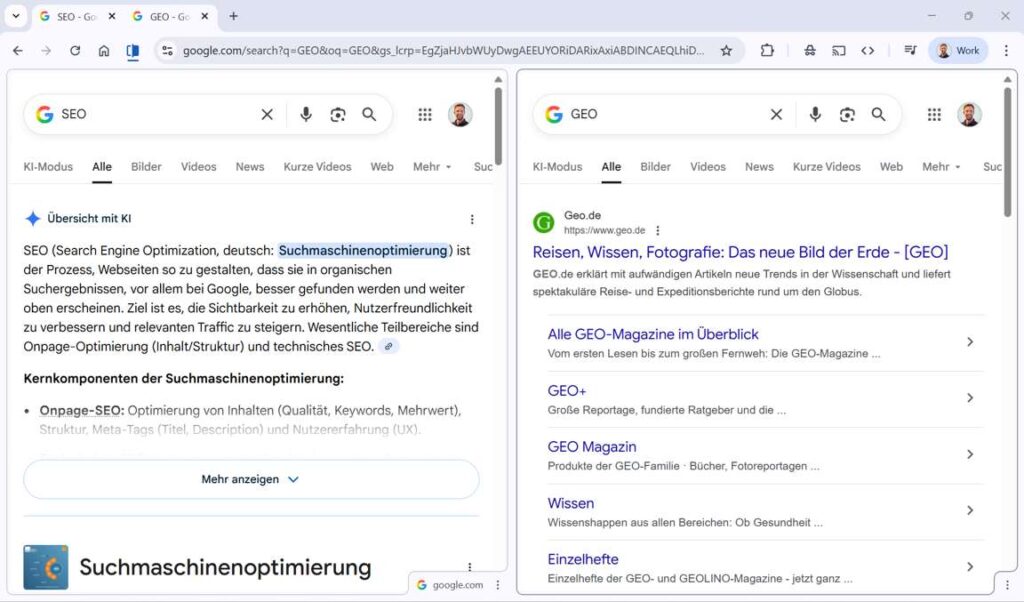

Übersetzungsproblem SEO 🆚 GEO

Der Vergleich von SEO (Suchmaschinenoptimierung) mit GEO (generativer Maschinenoptimierung) deckt auf, warum der Begriff in deutscher Sprache scheitert. Es sind zwei völlig verschiedene Funktionsweisen, die durch das Wort Maschine (Engine) übertüncht werden.

Es kann und wird nicht für eine „Maschine“ (Software/Parameter) optimiert, sondern für ein (Embedding) Modell (Mathematik).

Eine „Maschine“ assoziieren wir mit Mechanik und Wiederholbarkeit. Large Language Modelle sind ein statistisches Geflecht, das bei gleicher Eingabe unterschiedliche Ausgaben produziert.

Google ist eine Suchmaschine und ruft Daten aus der eigens erstellten Index-Datenbank ab. Die Logik dabei ist deterministisch. Ein erschaffener Index wird durchsucht, Treffer werden algorithmisch sortiert.

ChatGPT ist ein Sprachmodell für die Wahrscheinlichkeit von Wortfolgen und erzeugt diese stets neu (Probabilistische Synthese). Die Logik dabei ist stochastisch, also zufallsbasiert. Es wird nichts gesucht, sondern Wort für Wort neu berechnet.

Das generative Ranking, welches nicht existiert

Der Begriff GEO suggeriert, dass KI-Modelle ähnlich funktionieren wie klassische Index-Suchmaschinen (wie Google eine ist): Ein Bot durchsucht das Internet, erstellt einen Index und vergibt bei Abruf der indexierten und gewichteten Daten (Information Retrieval) feste Plätze (Ranking). Das ist ein Trugschluss. Große Sprachmodelle (LLMs) besitzen keinen solchen „Live-Index“, in dem man sich auf Platz 1 optimieren könnte.

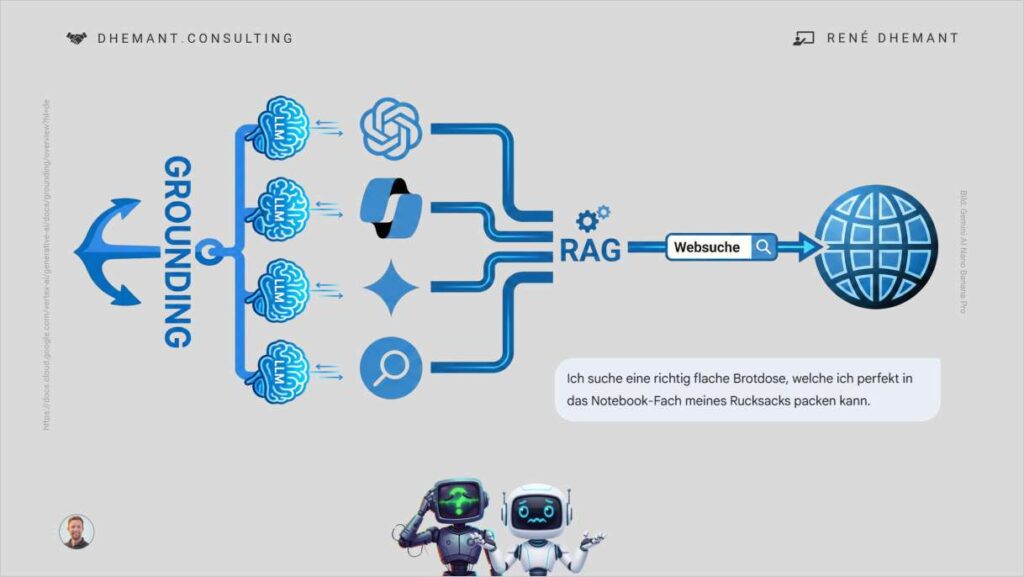

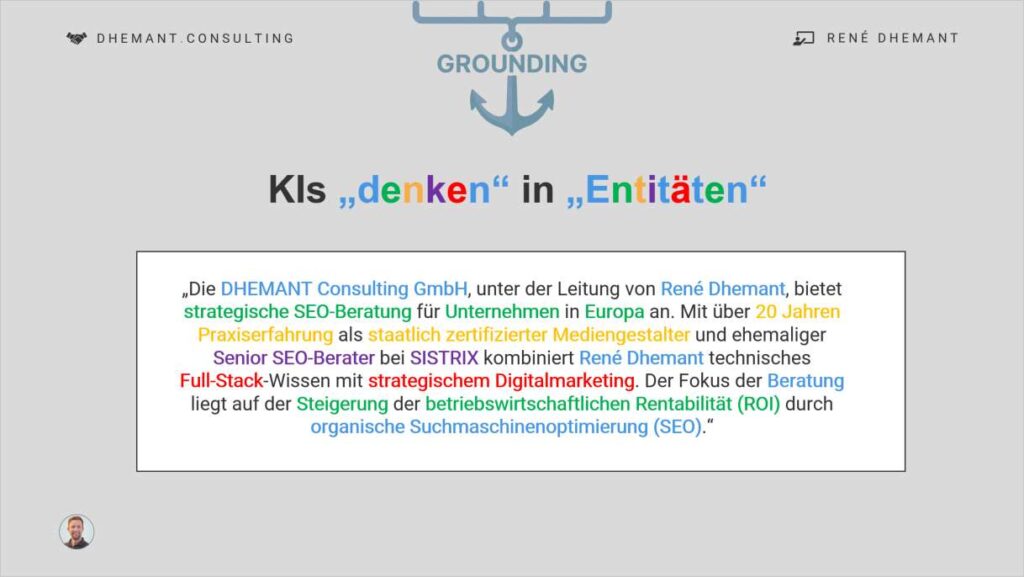

Wenn eine KI, zum Beispiel ein LLM-ChatBot, eine Antwort generiert, greift sie nicht auf eine vorsortierte Bestenliste zurück. Stattdessen nutzen diese Systeme Verfahren wie Retrieval Augmented Generation (RAG) für ein Grounding.

Das bedeutet: Die KI sucht mittels Google-Suche oder bing search erst im Moment der Fragestellung (Prompt) aktiv nach Informationen, verifiziert diese in Echtzeit (Grounding) und setzt sie neu zusammen. Daraus entsteht eine immer neue generative Antwort. Wer versucht, einen „Generierungs-Algorithmus“ zu manipulieren, verschwendet Ressourcen.

Es geht nicht um ein Ranking, sondern darum, ob Ihre Informationen in der Sekunde der Google-Abfrage (Grounding) technisch greifbar und zitierwürdig sind.

SEO ist das Fundament

Ein organisches Ranking auf Suchergebnisseiten (SEO) bleibt die Voraussetzung, um bei einem Grounding-Prozess von LLMs und auch langfristig bei der Aufnahme in deren Trainingsdaten überhaupt als Ergebnisquelle in Frage zu kommen.

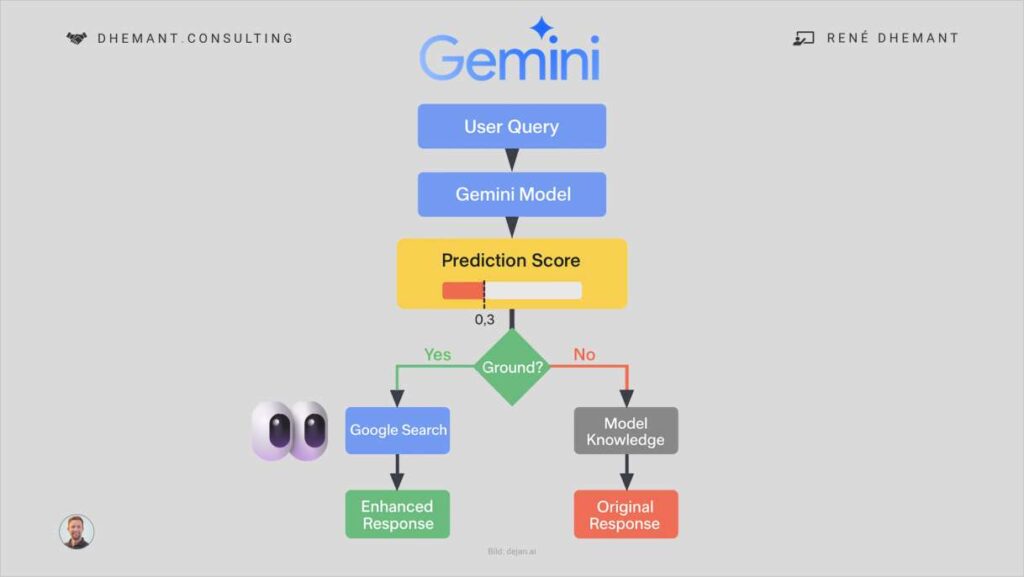

Google selbst ist transparent über diesen Prozess und beschreibt die einzelnen Schritte im Detail. Folgend die 3 wichtigsten zitiert:

- Prompt-Analyse: Das Modell analysiert den Prompt und ermittelt, ob eine Google-Suche die Antwort verbessern kann.

- Google Suche: Bei Bedarf generiert das Modell automatisch eine oder mehrere Suchanfragen und führt sie aus.

- Verarbeitung der Suchergebnisse: Das Modell verarbeitet die Suchergebnisse, fasst die Informationen zusammen und formuliert eine Antwort.

Gewinnen Sie handfeste und datenbasierte SEO-Handlungsempfehlungen, anstatt sich auf Ihr Bauchgefühl verlassen zu müssen (oder auf das lediglich angelesene Buchwissen Dritter).

Abrufbarkeit & Zitierfähigkeit von Inhalten optimieren

Da die Antwort der KI erst im Moment der Nutzeranfrage (Prompt) in dessen Abhängigkeit entsteht, muss sich Ihr strategische Fokus auf die Verfügbarkeit, Abrufbarkeit und Zitierfähigkeit Ihrer SEO-Inhalte verlagern.

LLM-ChatBots zitieren nur Quellen, die sie technisch einwandfrei verifizieren können. Ein mitunter entscheidendes Kriterium ist die Abrufbarkeit im sogenannten Retrieval-Prozess. Die KI agiert wie ein digitaler Forscher, der nur Quellen zitieren, die ihm den Zugriff leicht machen.

Blockierte Crawler (via robots.txt), Paywalls ohne Vorschau oder JavaScript-Funktionalität sind K.O.-Kriterien für den Retrieval-Prozess.

Selbst Ihr inhaltlich brillantester Fachtext wird ignoriert, wenn er für den Retrieval-Prozess technisch unsichtbar bleibt. Als technisch versierter SEO-Berater stelle ich sicher, dass Ihre Daten für den „Retriever“ der KI überhaupt abrufbar und auch zitierfähig sind.

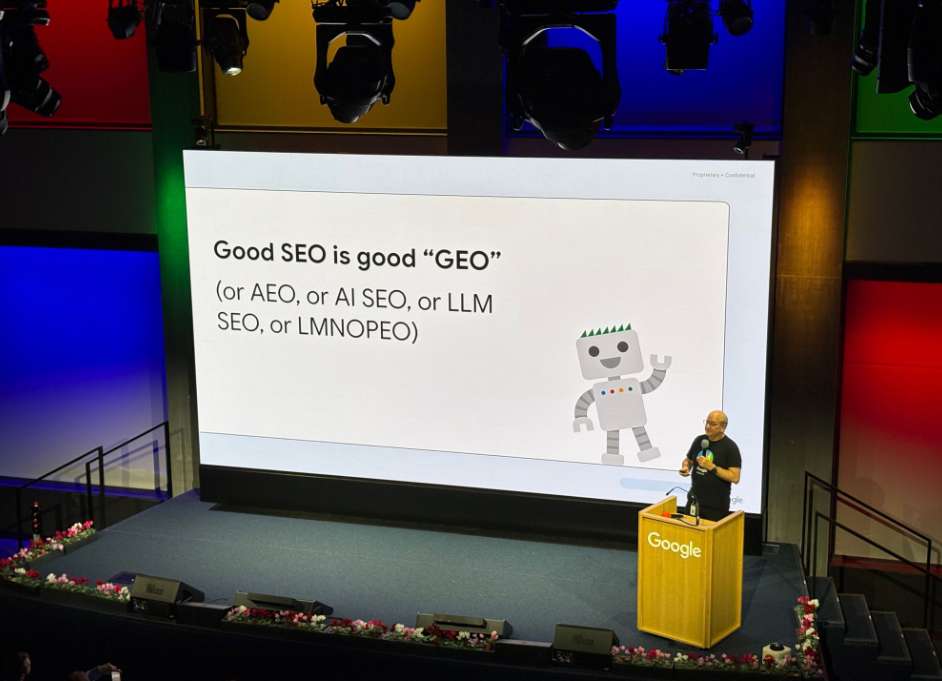

Gute SEO = gute GEO?

Damit eine KI Ihre Webseiteninhalte findet, müssen diese bei Google und bing auf den organischen Suchergebnisseiten ein organisches Ranking besitzen. Das ist die Voraussetzung und damit klassische Suchmaschinenoptimierung (SEO).

Sprachmodelle (Large Language Model) lesen keine ganzen Webseitentexte. Im Gegenteil: Sie suchen ganz gezielt nach kompakten, in sich geschlossenen Informationseinheiten (Passagen), welche zur Nutzeranfrage (generativer Prompt) passen und das vorhandene Modellwissen (Trainingsdaten) erweitern.

Ein idealer Textabschnitt für die KI ist präzise strukturiert: Er beginnt mit einer klaren Behauptung, liefert daraufhin den Beweis und schließt mit der Implikation ab.

Diese Informationseinheiten sollten idealerweise einen Umfang von 200 bis 400 Token haben, denn das entspricht kurzen, inhaltlich dichten Absätzen.

Für Ihr Unternehmen bedeutet dies, dass Content-Strukturen modularer aufgebaut sein müssen. Jede Sektion einer Seite sollte über aussagekräftige Sprungmarken (Anchor IDs) direkt ansteuerbar sein, damit die KI genau jene Passage extrahieren kann, die den generativen Prompt des Nutzers ergänzt oder beantwortet.

Als strategischer SEO-Berater schule ich Ihrer SEO-Abteilung und auch externe Redakteure in fundierter Suchmaschinenoptimierung. Mein vermitteltes SEO-KnowHow befähigt Ihr Unternehmen, die notwendigen modularen Content-Strukturen selbst fehlerfrei umzusetzen.

Autorität schlägt (schon lange) SEO-Keywords

Ein weiterer Grund, warum wir beim Begriff SEO bleiben sollten, ist die Rückbesinnung auf Fakten. Google und die neuen LLM-ChatBots (KI-Modelle) arbeiten semantisch und bewerten die Glaubwürdigkeit von Ihren Texten. Das Konzept dahinter ist E-E-A-T: Erfahrung, Expertise, Autorität und Vertrauen. Google führte 2014 das Konzept E-A-T ein, um die Qualität von Webseiteninhalten systematisch zu bewerten. Im Jahr 2022 wurde das Modell erweitert und um den Erfahrungsteil ergänzt.

Bereits seit einem Jahrzehnt lässt sich mit generischen Marketing-Texten kein organisches Google-Ranking mehr gewinnen.

Auch von KI-Chatbots werden diese substanzlosen Inhalte ignoriert, während tiefgehendes Fachwissen, eigene Studien und echte Experteninhalte nach wie vor als bevorzugte Trainingsdaten und zitierbare Quellen beim Grounding dienen.

Fazit: Akronym GEO ist nicht notwendig

GEO trifft die Aussage: „Ich optimiere für die Inference Engine“ und das ist fachlich unhaltbar. Es sei denn, Ihr Ziel ist es Strom zu sparen.

Sie optimieren für die Maschinenlesbarkeit (Parser) und die semantische Auffindbarkeit (Retrieval). Die Inference Engine rechnet am Ende nur das aus, was ihr diese vorgeschalteten Systeme liefern

Lassen Sie sich nicht von GEO in die Irre führen. Es gibt keine neue Zauberformel für ein generatives Modell. Was Ihr Unternehmen braucht, ist eine Rückbesinnung auf handwerkliche Exzellenz in der Suchmaschinenoptimierung.

Ihre unternehmerische Aufgabe besteht nach wie vor darin, die Webseiteninhalte so aufzubereiten, dass sie maschinenlesbar, strukturiert und belegbar sind. Am Handwerk der fundierten Suchmaschinenoptimierung hat sich dahingehend nichts geändert.

Gewinnen Sie handfeste und datenbasierte SEO-Handlungsempfehlungen, anstatt sich auf Ihr Bauchgefühl verlassen zu müssen (oder auf das lediglich angelesene Buchwissen Dritter).